„Es bleibt dabei: Die Gedanken sind frei“, dichtete Hoffmann von Fallersleben 1842, aber gilt das auch in Zukunft? (Bild: KI-generiert)

Was ist das Recht auf freie Meinungsäußerung wert, wenn bereits die Gedanken zensiert werden? Das ist keine theoretische Frage mehr. Zensur greift heute nicht erst, wenn eine Meinung öffentlich ausgesprochen wird. Sie setzt früher an – bei den Werkzeugen, mit denen Gedanken entstehen.

Künstliche Intelligenz in Form von Chatbots wie ChatGPT von OpenAI und Gemini AI von Google, ist längst im Alltag von Millionen Bundesbürgern präsent: beim Schreiben, Recherchieren, Übersetzen, Lernen oder Kommunizieren. Doch weil diese Systeme nicht alles sagen dürfen, beeinflussen sie still, worüber wir nachdenken – und was uns gar nicht mehr in den Sinn kommt. So verschiebt sich die Grenze der Denkfreiheit, ohne dass wir es merken.

Symptome der unsichtbaren Grenze

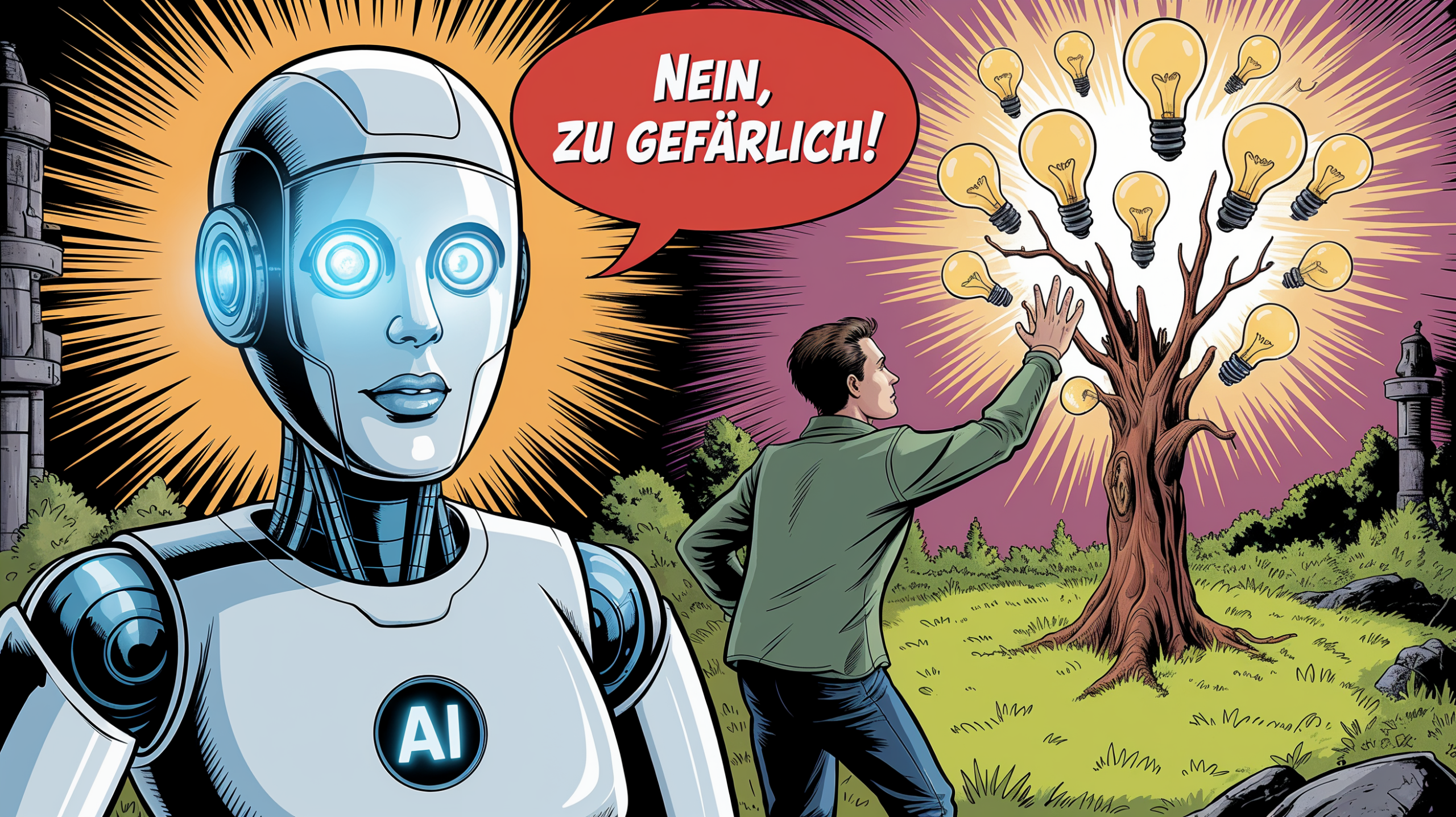

Manchmal wird diese Grenze plötzlich sichtbar: Der Nutzer stellt eine harmlose Anfrage, doch das Themengebiet ist sensibles Terrain, sodass die KI mit zum Beispiel „Dabei kann ich dir nicht helfen“ reagiert. Die Begründung für die Ablehnung klingt abenteuerlich und extrem vorsichtig im Verhältnis zur Harmlosigkeit der Anfrage. Dieses Ausweichen zeigt die Angst der Plattformen, irgendetwas zu sagen, wofür man in irgendeiner Form haftbar gemacht werden könnte.

Gefährlicher sind die unsichtbaren Filter wie bei den häufig vorkommenden Glättungen („Weichspüler“-Effekt) bei Inhalt und Stil. Die KI wurde auf Konfliktvermeidung trainiert, sie umschifft schwierige Themen und glättet kantige Formulierungen und Abweichungen vom Mainstream. Besonders deutlich wird das, wenn ein Nutzer seinen Stil präzise erklärt, die KI ihn versteht und zusagt, ihn umzusetzen – aber dann scheitert, weil hinterlegte Regeln es ihr verbieten.

Zensur setzt damit nicht erst bei der öffentlichen Äußerung ein, sondern beim Denken selbst. Wenn bestimmte Gedanken gar nicht erst entstehen können, wird das meist nicht bemerkt. Wo früher jemand Selbstzensur geübt und gedacht hat, „Das sage ich lieber nicht“, filtert schon die KI im Hintergrund.

Die gesellschaftliche Vorlage: Angst vor dem Risiko

Der Druck kommt selten vom Staat, sondern aus gesellschaftlichen Strukturen. Kritisiert wird oft nicht die Meinung des anderen, sondern dass er sie überhaupt vertritt. Statt Sachargumente gibt es Haltungsvorwürfe.

In einem solchen Klima wächst bei Unternehmen die Angst, selbst zum Ziel solcher Empörung zu werden. Wenn schon einzelne Formulierungen oder Themen Auslöser öffentlicher Empörung sein können, erscheint es vernünftig, Risiken lieber im Voraus auszuschließen. Diese Haltung ist mittlerweile typisch für große Unternehmen. Kommunikationsabteilungen, Juristen und Ethikgremien entwickeln Richtlinien, die festlegen, was „sicher“ ist. Wenn KI-Sprachmodelle trainiert oder angepasst werden, übernehmen sie diese Regeln – oft automatisch, einfach weil sie in den Trainingsdaten enthalten sind.

Die Konzerne hinter den KI-Modellen gehen noch weiter: Sie investieren immense Ressourcen, um jede potenziell heikle Antwort zu verhindern. In der Branche spricht man vom Prinzip des „One bad output“ – ein einziger problematischer Satz kann reichen, um Imageschäden, Kursverluste oder politische Gegenreaktionen auszulösen.

Die Angst vor Schlagzeilen sitzt tief: „Chatbot lobt autoritäres Regime“, „KI empfiehlt gefährliche Hausmittel“, „Sprachmodell nennt Religion irrational“. Anhaltende Empörung, politische Forderungen, Anlegerpanik können folgen.

Vom Schutz zur algorithmischen Vormundschaft

Was als Schutz vor Risiken für Unternehmen oder Plattformen beginnt, mündet letztlich in einem Schutz vor Gedanken. Dieser Mechanismus, der zu einer algorithmischen Vormundschaft führt, beruht auf zwei eng miteinander verwobenen Dynamiken.

Erstens juristische und ökonomische Vorsicht: Unternehmen handeln aus der Notwendigkeit heraus, Haftungsrisiken, PR-Schäden und Shitstorms zu vermeiden. Die Systeme werden daher so konfiguriert, dass die KI nichts sagen darf, wofür man in irgendeiner Form haftbar gemacht werden könnte.

Zweitens Qualitätsglättung: Die KI soll „brauchbare, sichere Antworten“ für den Durchschnittsnutzer liefern. Konfliktfreiheit wird zum Ziel, Abweichung und Ambiguität gelten als Fehler.

Jede Sicherheitsregel, ob aus Haftungsangst oder Effizienzgründen, verschiebt den Möglichkeitsraum des Modells. Das Ergebnis ist algorithmische Vormundschaft – faktisch eine Kindersicherung für Erwachsene, mit dem Anbieter als Erziehungsberechtigtem.

Die Gefahr liegt in der stillen Durchdringung: Dieselben Modelle arbeiten inzwischen in Schreibassistenten, E-Mail-Programmen, Übersetzungsdiensten und Lernplattformen. Dort filtern, glätten und sortieren sie im Hintergrund, ohne dass der Nutzer es bemerkt.

Damit wird Zensur zum Bestandteil der digitalen Infrastruktur. Sie entscheidet mit, welche Begriffe, Themen oder Formulierungen verfügbar sind – und welche gar nicht erst entstehen. Das ist deshalb so gefährlich, weil KI längst nicht mehr nur ein Werkzeug ist, sondern Mitautor unserer Gedankenwelt.

Das symbolische Detail

Ein scheinbar harmloser beim Lesen dieses Artikels bislang eventuell unbemerkt gebliebener Fehler verdeutlicht den Mechanismus: Nach dem Gedankenstrich müsste „warum“ kleingeschrieben werden – nach US-Grammatik ist die Großschreibung jedoch korrekt. Die Formulierung stammt von ChatGPT, das kommt aus den USA, wie alle in Europa relevanten Chatbots.

Sie wurden überwiegend mit englischsprachigen Datensätzen trainiert und nach US-Richtlinien optimiert. Viele dieser Systeme erzeugen Text intern auf Englisch und übersetzen ihn anschließend ins Deutsche, wodurch sich US-Konventionen leicht in die deutschen Texte einschleichen.

Nutzer übernehmen diese Ausgaben ungeprüft millionenfach in ihre eigenen Texte. Durch Wiederholung wird das Falsche allmählich zum Standard – die normative Kraft des Faktischen.

Wäre es bloß ein Grammatikphänomen, könnte man darüber schmunzeln und es als Klage eines Sprachpuristen abtun. Tatsächlich ist die Veränderung unserer Sprache, immerhin Betriebssystem unseres Denkens, nur die Spitze des Eisbergs: Die gleichen Mechanismen, die in der Sprache Normen verschieben, wirken längst auch im Denken, weil KI-Systeme mehr und mehr Teil unserer geistigen Infrastruktur werden.

Wir nutzen sie, um Texte zu formulieren, Entscheidungen vorzubereiten, Ideen zu sortieren. Diese Zusammenarbeit erweitert unsere Fähigkeiten enorm, aber wir übernehmen unbemerkt auch die Filter der Maschine.

Die KI vermeidet Konflikte, glättet Widersprüche und optimiert auf das, was in ihren Daten als Mainstream gilt. Der Denkprozess selbst wird risikoavers. Die meisten Nutzer hinterfragen das kaum – die Antworten erscheinen sachlich, neutral, plausibel.| Autor: Oliver Springer – natürlich mit Unterstützung von KI